以下文章节选自丨腾讯科技

牢牢掌握算力分配权的英伟达是人工智能领域当仁不让的“炸子鸡”。英伟达在发布H200时就透露,下一代B100芯片将在2024年推出,性能已经“望不到头”,全网直呼炸裂。

当地时间3月18日,英伟达举行一年一度的GTC2024新品发布会,黄仁勋将发表主题演讲《见证AI的变革时刻》,并发布了新一代的AI算力芯片B100。B100将作为英伟达在2023年11月推出的H200的升级版本,稍后上市。

作为经典型号H100的下一代,H200拥有141GB的内存、4.8TB/秒的带宽,能够与H100相互兼容,在推理速度上几乎达到了H100的两倍,预计将于2024年二季度开始交付。

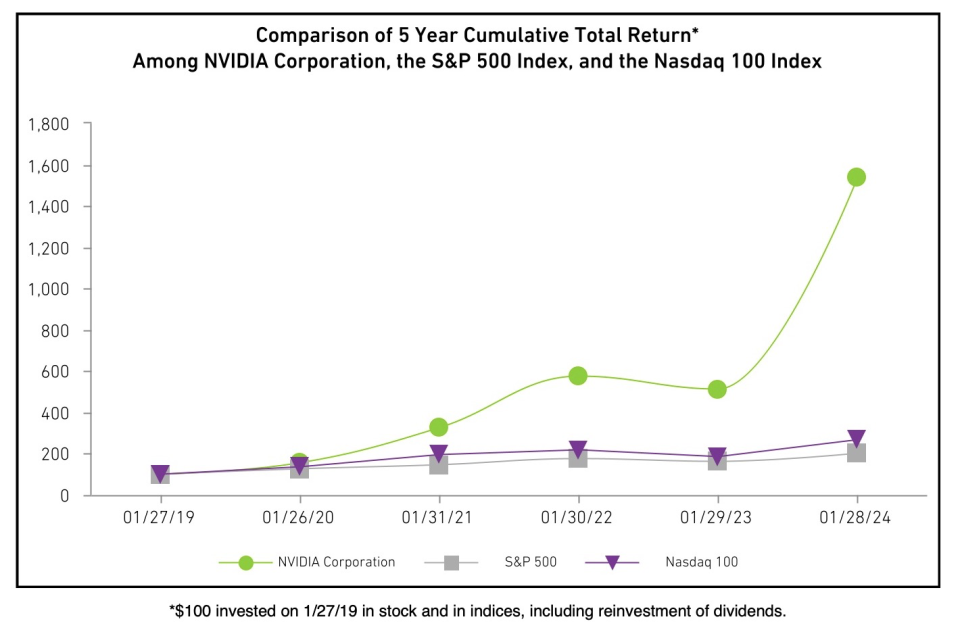

英伟达通过为包括OpenAI、Meta等人工智能企业提供包括H200、H100、A100等不同规格的GPU,一跃成为全球市值增速最快的企业之一,也因此被外界称之为人工智能时代的”卖水人“。

今年的GTC2024上,黄仁勋的AI“核武库”正式上新,B200将成为科技巨头们追逐的“算力明星”——它不仅会成为新的AI算力底座,也将成为英伟达市值继续攀升的业绩底座。

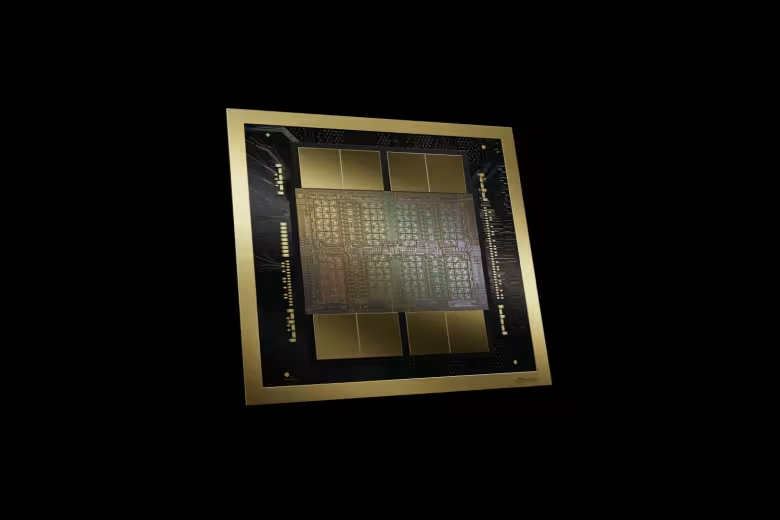

作为NVIDIA Blackwell架构首款新产品,B200采用双芯片设计,晶体管数量达到2080亿个,基于Blackwell架构的B100.英伟达还提供了包括GB200、DGX GB200 NVL 72.以及基于GB200和B200打造的DGX SuperPOD超算平台。

软件服务方面,英伟达发布了集成AI开发软件微服务系统NIM,通过直接提供多行业、多模态的专有模型,以及基于NeMo Retriver的专有数据注入系统,企业可借由NIM快捷部署公司级专有模型。

除了通过软硬件赋能AI技术之外,英伟达也推出了加速AI仿生机器人落地的解决方案——GR00T机器人项目——世界首款人形机器人模型,支持通过语言、视频和人类演示,为机器人的生成行动指令。

以下为核心要点:

● B200芯片:采用双芯片设计,晶体管数量达到2080亿个。单GPU AI性能达20 PFLOPS(即每秒2万万亿次)。内存192GB,基于第五代NVLink,带宽达到8TB/s。

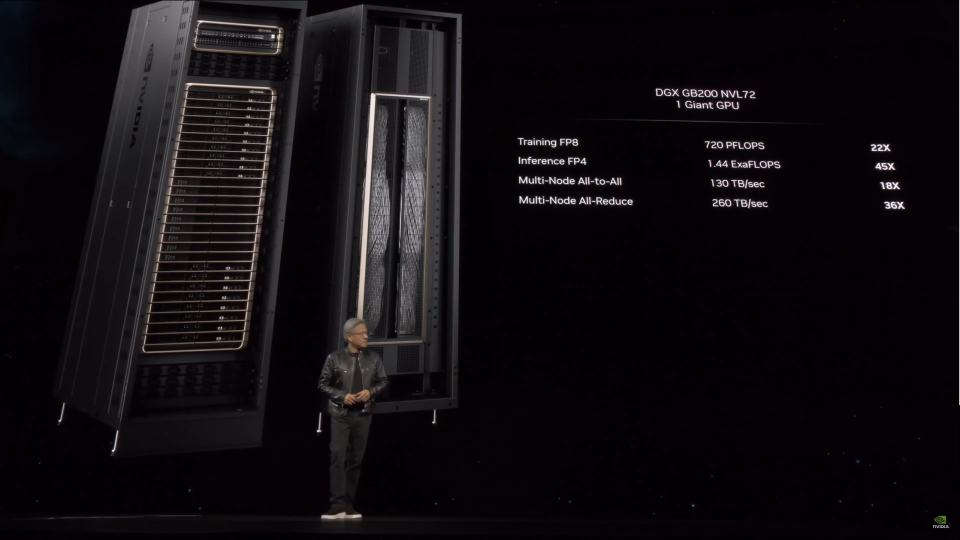

● DGX GB200 NVL 72:内置36颗GRACE CPU和72颗Blackwell架构GPU,AI训练性能可达720PFLOPs(即每秒72万万亿次),推理性能为1440PFLOPs(每秒144万万亿次)。

● 基于GB200的DGX SuperPOD超算:搭载8颗DGX GB200.即288颗Grace CPU和576颗B200 GPU,内存达到240TB,FP4精度计算性能达到11.5EFLOPs(每秒11.5百亿亿次)

● Project GR00T:人型机器人项目——包含了人型机器人基础模型,ISAAC Lab开发工具库和Jetson Thor SoC片上系统开发硬件,带宽达到100GB/s,AI计算性能达到800TFLOPs。

● NIM软件:针对AI推理系统的新软件,开发人员可以在其中直接选择模型来构建利用自己数据的人工智能应用程序。

具体来说,英伟达最近几代架构,在名称上都有致敬科学家的惯例。比如,上一代产品Hopper架构则是致敬格蕾丝·霍珀,这一代架构Blackwel则是致敬的是统计学家兼数学家大卫·布莱克韦威尔。

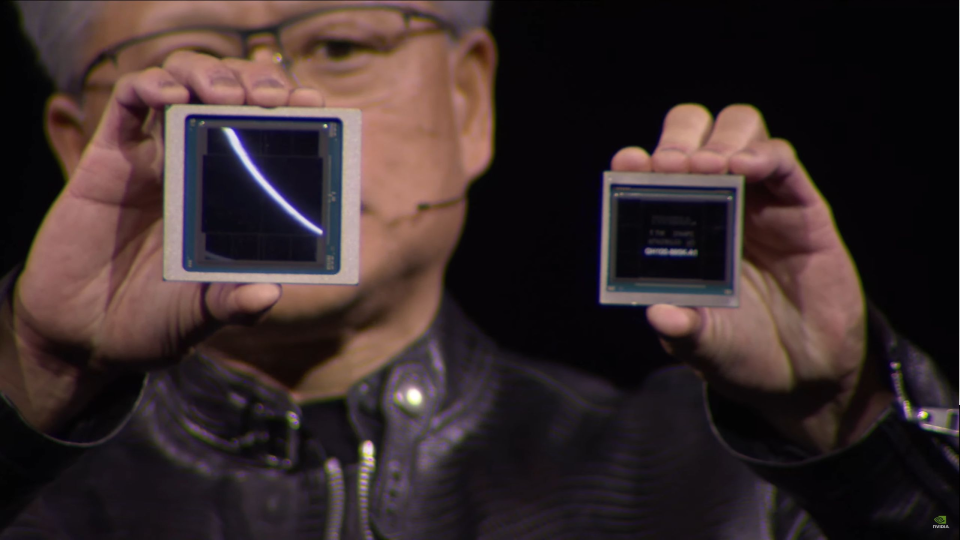

黄仁勋展示Blackwell和Hopper架构GPU对比,左边为Blackwell架构的B200芯片

在新一代的GPU正式亮相之前,关于架构、双芯片设计等已经有不少传闻,关注点在于,黄仁勋会把手中的“AI核弹”性能提升到多少?

现在,官方的答案给出来了——基于Blackwell架构的B200采用双芯片设计,基于台积电4nm工艺,晶体管数量达到2080亿个,上一代Hopper架构的H100同样是4nm工艺,但由于没有上双芯片设计,晶体管数量只有800亿。

B200搭配8颗HBM3e内存(比Hopper架构的H200多了2颗),内存达到192GB,基于第五代NVLink,带宽达到8TB/s,相比Hopper架构和Ampere架构,有了巨幅提升,最大可支持10万亿参数的模型的训练。

作为对比,OpenAI 的 GPT-3 由 1750 亿个参数组成,GPT-4参数为1.8万亿。

黄仁勋还介绍称,B200平台可以向下兼容,支持与上一代Hopper架构的H100/H200 HGX系统硬件适配。

此前,被称之为OpenAI劲敌的Inflection AI,官宣建立了一套22000颗英伟达H100 GPU的世界最大人工智能数据中心集群,接下来要看看OpenAI,能不能借助B200反超了。

这里再插一句英伟达的NVLink和NVLink Switch技术。

其中NVLink是英伟达开发的CPU和GPU之间高速互联通道,在内存墙无法突破的情况下,最大化提升CPU和GPU之间通信的效率,于2016年在基于Pascal架构的GP100芯片和P100运算卡上率先采用,当时的带宽为160GB/s,到H100采用的第四代NVLink,其带宽已经达到900GB/s,而B200采用的第五代NVLink 带宽已经突破1.8TB/s。

NVLink Switch支持与多个NVLink连接,实现NVLink在单节点、节点之间互联,进而创建更高带宽的GPU集群,基于最新的NVLink Switch芯片(基于台积电的4nm工艺,500亿个晶体管),可实现576颗GPU组成计算集群,上一代产品仅支持到256个GPU。

根据官方公布的数据,B200支持第二代Transformer引擎,Tensor核支持FP4、FP6精度计算,单颗B200 GPU的AI性能达20 PFLOPs(即每秒2亿亿次)。

另外,英伟达还在主题演讲中展示了全新的加速计算平台DGX GB200 NVL 72拥有9个机架,总共搭载18个GB200加速卡,即36颗GRACE CPU和72颗Blackwell架构GPU(英伟达也提供了HGX B200版本,简单来说就是用Intel的Xeon CPU,替换了Grace CPU)。

黄仁勋说,一套DGX版GB200 NVL 72总共内置了5000条NVLink铜制线缆,总长度达到2公里,可以减少20kW的计算能耗。

举个例子,8000个GPU组成的GH100系统,90天内可以训练一个1.8万亿参数的GPT-Moe模型,功耗15兆瓦,而使用一套2000颗GPU的GB200 NVL72加速卡,只需要4兆瓦。

据介绍,DGX版GB200 NVL 72加速计算平台AI训练性能(FP8精度计算)可达720PFLOPs(即每秒72亿亿次),FP4精度推理性能为1440PFLOPs(每秒144亿亿次)。官方称GB200的推理性能在Hopper平台的基础上提升6倍,尤其是采用相同数量的GPU,在万亿参数Moe模型上进行基准测试,GB200的性能是Hopper平台的30倍。

演讲环节,黄仁勋还公布了搭载64个800Gb/s端口、且配备RoCE自适应路由的NVIDIA Quantum-X800 InfiniBand 交换机,以及搭载144个800Gb/s端口,网络内计算性能达到14.4TFLOPs(每秒14.4万亿次)的Spectrum-X800交换机。两者应对的客户需求群体略有差异,如果追求超大规模、高性能可采用NVLink+InfiniBand网络;如果是多租户、工作负载多样性,需融入生成式AI,则用高性能Spectrum-X以太网架构。

另外,英伟达还推出了基于GB200的DGX Super Pod一站式AI超算解决方案,采用高效液冷机架,搭载8套DGX GB200系统,即288颗Grace CPU和576颗B200 GPU,内存达到240TB,FP4精度计算性能达到11.5ELOPs(每秒11.5百亿亿次),相比上一代产品的推理性能提升30倍,训练性能提升4倍。

黄仁勋说,如果你想获得更多的性能,也不是不可以——发挥钞能力——在DGX Super Pod中整合更多的机架,搭载更多的DGX GB200加速卡。