上次有说过,我在新公司有部分工作是负责爬虫业务的,爬虫机器有上百台,节点也要计划迁入了Docker平台上。 这两天遇到一个棘手的问题,就是因为我们为了追求数据量,在某些机房,用docker启动了不少爬虫节点,导致一些傻逼网站,开始封禁我们…. … (干死他们,哥们要是有资源,必须干掉ddos,让你防 ! 当然我也就装装逼,没这个资源)

对于爬虫被封禁 ! 爬虫一般来说只要你的ip够多,是不容易被封的。 一些中小网站要封杀你,他的技术成本也是很高的,因为大多数网站没有vps,他们用的是虚拟空间或者是sae,bae这样的paas云。 其实就算他们不考虑seo搜索优化,用ajax渲染网页数据,我也可以用webkit浏览器组件来搞定ajax之后的数据。

如果某个网站他就是闲的蛋疼,他就是喜欢从log里面,一行行的分析出你的ip,然后统计处频率高的网站, 那这个时候咋办? 其实方法很草比,就是用大量的主机,但是大量的主机是有了,你如果没有那么爬虫的种子量,那属于浪费资源… … 其实一个主机,多个ip是可以的。。。

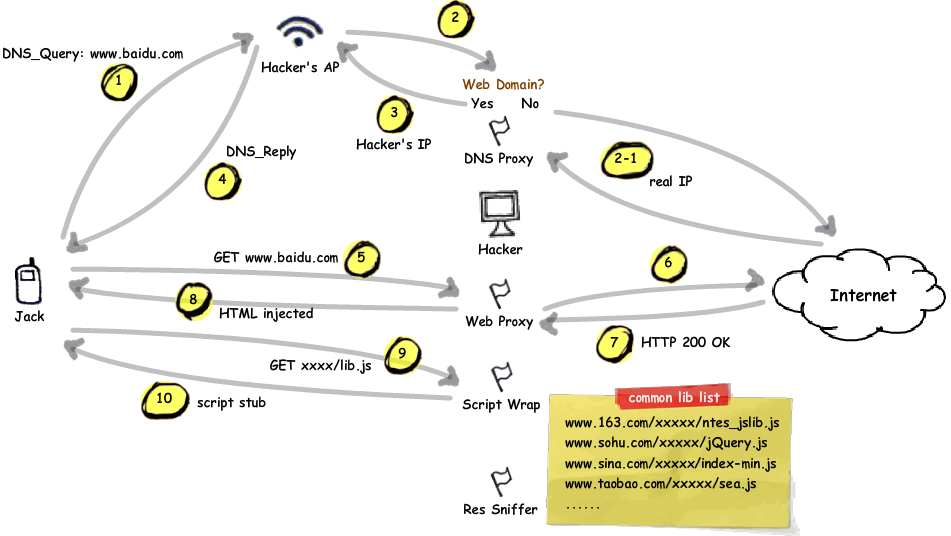

这个时候是有两种方法可以解决的,第一个是用squid绑定多个ip地址,做正向代理…. 你的程序里面维持一组连接池,就是针对这几个正向proxy做的连接池。

正向代理和反向代理最大的区别就是,反向代理很多时候域名是固定的,而正向代理是通过一个http的代理端口,随意访问,只是在proxy端会修改http协议,去帮你访问

如果是python,其实单纯调用socket bind绑定某个ip就可以了,但是标题的轮训是个什么概念,就是维持不同的socket bind的对象,然后你就轮吧 ! 跟一些业界做专门做爬虫的人聊过,他们用的基本都是这样的技术。

# -*- coding=utf-8 -*-

import socket

import urllib2

import re

true_socket = socket.socket

ipbind='xx.xx.xxx.xx'

def bound_socket(*a, **k):

sock = true_socket(*a, **k)

sock.bind((ipbind, 0))

return sock

socket.socket = bound_socket

response = urllib2.urlopen('http://www.ip.cn')

html = response.read()

ip=re.search(r'code.(.*?)..code',html)

print ip.group(1)

在http://stackoverflow.com/ 上也找到一些个老外给与的解决方法的思路,他是借助于urllib2的HTTPHandler来构造的出口的ip地址。

import functools

import httplib

import urllib2

class BoundHTTPHandler(urllib2.HTTPHandler):

def __init__(self, source_address=None, debuglevel=0):

urllib2.HTTPHandler.__init__(self, debuglevel)

self.http_class = functools.partial(httplib.HTTPConnection,

source_address=source_address)

def http_open(self, req):

return self.do_open(self.http_class, req)

handler = BoundHTTPHandler(source_address=("192.168.1.10", 0))

opener = urllib2.build_opener(handler)

urllib2.install_opener(opener)

import functools

import httplib

import urllib2

class BoundHTTPHandler(urllib2.HTTPHandler):

def __init__(self, source_address=None, debuglevel=0):

urllib2.HTTPHandler.__init__(self, debuglevel)

self.http_class = functools.partial(httplib.HTTPConnection,

source_address=source_address)

def http_open(self, req):

return self.do_open(self.http_class, req)

handler = BoundHTTPHandler(source_address=("192.168.1.10", 0))

opener = urllib2.build_opener(handler)

urllib2.install_opener(opener)

那么就有一个现成的模块 netifaces ,其实netifaces模块,就是刚才上面socket绑定ip的功能封装罢了

地址: https://github.com/raphdg/netifaces

import netifaces

netifaces.interfaces()

netifaces.ifaddresses('lo0')

netifaces.AF_LINK

addrs = netifaces.ifaddresses('lo0')

addrs[netifaces.AF_INET]

[{'peer': '127.0.0.1', 'netmask': '255.0.0.0', 'addr': '127.0.0.1'}]

import netifaces

netifaces.interfaces()

netifaces.ifaddresses('lo0')

netifaces.AF_LINK

addrs = netifaces.ifaddresses('lo0')

addrs[netifaces.AF_INET]

[{'peer': '127.0.0.1', 'netmask': '255.0.0.0', 'addr': '127.0.0.1'}]

感谢阅读,希望能帮助到大家,谢谢大家对本站的支持!

到此这篇关于Python 爬虫如何使用动态切换ip防止封杀就介绍到这了。流过泪的眼睛更明亮,滴过血的心灵更坚强!更多相关Python 爬虫如何使用动态切换ip防止封杀内容请查看相关栏目,小编编辑不易,再次感谢大家的支持!